Die überraschenden soziotropen Effekte von generativer KI auf sozialpolitische Präferenzen

Matthias Haslberger, Jane Gingrich, Jasmine Bhatia

18th February 2026

Mit dem raschen Einzug generativer KI in die Arbeitswelt stellt sich eine entscheidende Frage: Wie reagieren Arbeitnehmer, wenn sie diese Technologie tatsächlich nutzen? Die Antwort darauf ist für die Sozialpolitik und die politische Stabilität von enormer Bedeutung. Unsere experimentelle Studie mit über 1.000 Erwachsenen in Grossbritannien zeigt ein überraschendes Muster, das jahrzehntelanger Forschung zur Automatisierung widerspricht: Der Kontakt mit KI erhöht nicht die Angst vor dem Verlust des Arbeitsplatzes, sondern stärkt paradoxerweise die Unterstützung für politische Massnahmen, die anderen helfen, sich an den technologischen Wandel anzupassen.

Seit Jahrzehnten stützt sich die politikökonomische Forschung zu neuen Technologien auf das „Risiko-Versicherungs-Modell”. Nach diesem Modell erhöht der Kontakt mit Technologie die von den Menschen wahrgenommene Gefahr des Arbeitsplatzverlusts, was wiederum die Nachfrage nach sozialpolitischen Massnahmen wie Arbeitslosenunterstützung erhöht. Dieses Muster bestätigte sich weitgehend bei früheren Automatisierungswellen: Robotisierung und der routine-orientierte technologische Wandel betrafen vor allem die Arbeiterklasse, die darauf mit der Forderung nach Ausgleichsmassnahmen reagierte.

Wir erwarteten, dass generative KI dem gleichen Muster folgen würde. In unserem präregistrierten Experiment, das im Juli 2023 durchgeführt wurde, erledigten die Teilnehmenden drei realistische Arbeitsaufgaben: eine berufliche E-Mail verbessern, widersprüchliche Argumente bewerten und Fragen zu komplexen Texten beantworten. Dabei teilten wir sie zufällig in zwei Gruppen ein, welche angewiesen wurden, die Aufgaben entweder mit oder ohne Hilfe von ChatGPT zu erledigen. Anschliessend erfassten wir ihre Wahrnehmung des Arbeitsplatzrisikos und ihre sozialpolitischen Präferenzen.

Mehr Unterstützung für Sozialpolitik – trotz geringerer Risikowahrnehmung

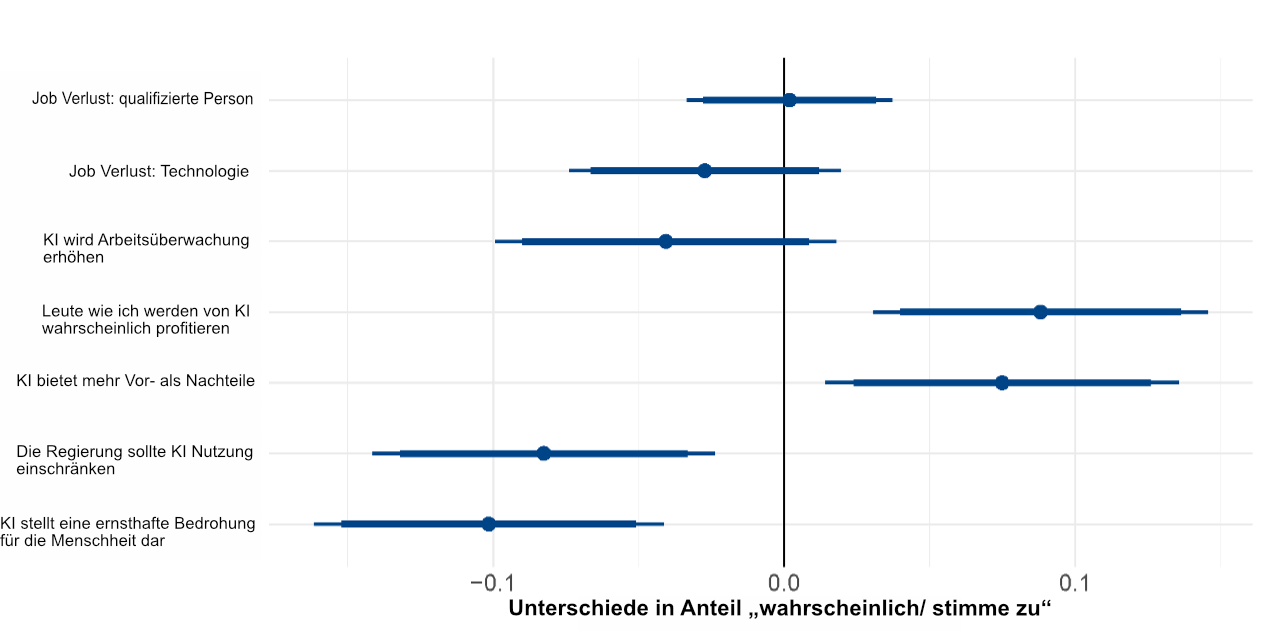

Die Ergebnisse waren überraschend: Befragte, die ChatGPT nutzten, hatten keine grössere Angst vor Arbeitsplatzverlust als diejenigen, die die Aufgaben ohne KI-Unterstützung erledigten, wie Abbildung 1 zeigt. Obwohl sie aus erster Hand erlebt hatten, wie KI die Produktivität bei alltäglichen Arbeitsaufgaben steigert, sahen sie keine grössere Gefahr für ihre Beschäftigungsaussichten. Tatsächlich entwickelten sie in mehreren Dimensionen deutlich positivere Einstellungen gegenüber KI: Sie waren 8–9 Prozentpunkte eher geneigt, KI als vorteilhaft für sich selbst und die Gesellschaft zu betrachten, und 8–10 Prozentpunkte weniger geneigt, sie als Bedrohung anzusehen, die staatliche Beschränkungen erfordert.

Abbildung 1: Wahrgenommene Bedrohung durch KI und Unterstützung sozialpolitischer Massnahmen

Abbildung: Haslberger, M., Gingrich, J., & Bhatia, J. (2025)

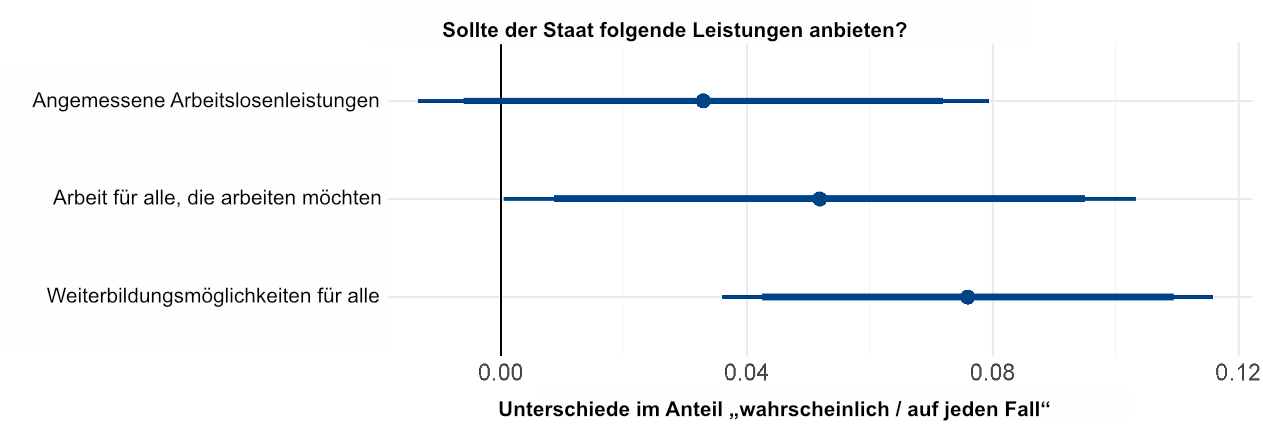

Interessanterweise äusserten die Befragten in der Interventionsgruppe, obwohl sie sich persönlich nicht bedroht fühlten, signifikant stärkere Unterstützung für aktivierende Sozialpolitik, wie Abbildung 2 zeigt – insbesondere für staatlich finanzierte Umschulungsmöglichkeiten (fast 8 Prozentpunkte höher) und Arbeitsplatzgarantien (etwa 5 Prozentpunkte höher). Dieses Muster widerspricht dem Risiko-Versicherungs-Modell: Wenn Menschen sich selbst nicht gefährdet fühlen, warum sollten sie dann teure Massnahmen unterstützen, die anderen bei der Anpassung an den technologischen Wandel helfen sollen?

Abbildung 2: Effekt von KI-Exposition auf sozialpolitische Präferenzen

Abbildung: Haslberger, M., Gingrich, J., & Bhatia, J. (2025)

Soziotrope Präferenzen: Sorge um andere

Wir argumentieren, dass dies soziotrope Präferenzen widerspiegelt – Menschen unterstützen politische Massnahmen nicht aus Eigeninteresse, sondern aus Sorge um andere, die negativ betroffen sein könnten. Frühere Forschung zeigt, dass dies voraussetzt, dass die Begünstigten als unterstützenswert angesehen werden. Mehrere Faktoren machen dies im Fall der Verlierer der KI-Entwicklung wahrscheinlich:

Erstens macht es die Geschwindigkeit und Tragweite des Fortschritts bei KI im Vergleich zu langsameren Automatisierungsprozessen schwieriger, potenziellen Verlierern die Schuld für mangelnde Anpassung zu geben. Zweitens ist im Gegensatz zu früheren Automatisierungswellen, die eindeutig auf Routinearbeiten abzielten, weniger offensichtlich, wer von generativer KI gewinnt und wer verliert. Dieser rasche Wandel und die anhaltende Unsicherheit machen es wahrscheinlich, dass Verlierer als unterstützungswürdig angesehen werden.

Darüber hinaus könnten Early Adopters (wie unsere ChatGPT-nutzende Stichprobe) sich selbst als Vorreiter betrachten und darauf vertrauen, dass sie zu den Gewinnern gehören werden, selbst wenn andere zurückfallen. Dies schafft Raum für grosszügige sozialpolitische Präferenzen gegenüber weniger Begünstigten.

Geschlechter- und Berufsunterschiede

Interessanterweise konnten wir signifikante geschlechtsspezifische Unterschiede feststellen. Frauen in der Kontrollgruppe hatten mehr Angst als Männer, ihren Arbeitsplatz an jemanden mit besseren Technologiekenntnissen zu verlieren, während in der Interventionsgruppe das Gegenteil der Fall war. Folglich wurde der soziotrope Effekt auf sozialpolitische Präferenzen in erster Linie von Männern getragen. Männer in der Interventionsgruppe befürworteten Arbeitslosenunterstützung deutlich stärker als Frauen, was wiederum das Muster der Kontrollgruppe umkehrte, und sie waren die Haupttreiber des Effekts auf die Unterstützung für Umschulungsmassnahmen. Unterschiede zwischen Berufsgruppen waren hingegen weniger ausgeprägt als erwartet. Obwohl Angehörige höherer Berufsgruppen wohl am stärksten den Fähigkeiten generativer KI ausgesetzt sind, fanden wir im Vergleich zu anderen Arbeitnehmern keine systematischen Unterschiede darin, wie die KI-Exposition ihre Risikowahrnehmung oder sozialpolitischen Präferenzen beeinflusste.

Ein Window of Opportunity?

Unsere Ergebnisse deuten auf eine (möglicherweise nur kurzzeitige) Chance für eine progressive Sozialpolitik hin. Derzeit schaffen die Wahrnehmung, dass die negativ betroffenen Personen keine persönliche Verantwortung trifft, und die Unsicherheit über die Verteilungseffekte der KI Raum für eine breite Unterstützung aktivierender Massnahmen wie Umschulungsprogramme, selbst unter Menschen, die sich Vorteile von der KI versprechen.

Dieses Window of Opportunity könnte jedoch nicht lange offen bleiben. Wenn die Fähigkeiten von KI zunehmen und ihre disruptiven Auswirkungen greifbarer werden, könnte das vom Risiko-Versicherungs-Modell vorhergesagte eigeninteressierte Kalkül wieder die Oberhand gewinnen. Sobald sich Menschen klar als Gewinner oder Verlierer identifizieren, dürften sich ihre politischen Präferenzen entsprechend verschieben. Die Rolle der Unternehmen wird dabei entscheidend sein. Wenn Unternehmen KI-Anwendungen priorisieren, die die Arbeitnehmer komplementieren, anstatt sie zu ersetzen – insbesondere bei Einstiegspositionen –, könnte dies die Rückkehr zum Nullsummendenken über technologischen Wandel verhindern.

Jenseits von Eigeninteresse

Unsere Studie stellt die Annahme in Frage, dass die Reaktionen von Menschen auf technologischen Wandel in erster Linie von eng definiertem Eigeninteresse getrieben sind. Zumindest in der Frühphase der KI-Verbreitung scheint die Konfrontation mit KI umfassendere Überlegungen zu Fairness und gesellschaftlichen Folgen anzustossen. Die derzeitige Unsicherheit ermöglicht paradoxerweise eine grosszügigere Haltung gegenüber denjenigen, die geschädigt werden könnten.

Für politische Entscheidungsträger bedeutet dies eine Chance, präventive Investitionen in Humankapital und Anpassung voranzutreiben. Anstatt abzuwarten, bis es zu Verwerfungen kommt, könnten Regierungen die gegenwärtige Bereitschaft nutzen, um robuste Rahmenbedingungen zu schaffen, die Arbeitnehmern bei der Anpassung an die KI-Wirtschaft helfen.

Werden sie diese Chance ergreifen, bevor sich das Fenster schliesst?

Abbildung: unsplash.com